È giusto salvare una vita impedendo di salvarne milioni?

Un dilemma etico nella serie “The Last of Us” ammette declinazioni alternative ed è alla base di diverse situazioni concrete (spoiler)

Nell’ultimo episodio della prima stagione di The Last of Us, l’apprezzatissima serie tv statunitense tratta da un videogioco del 2013, una decisione presa dal protagonista maschile della storia, Joel, ha fornito a molte persone uno spunto di riflessione e conversazione su un argomento noto e dibattuto nel campo della filosofia morale. In estrema sintesi, semplificando un po’, Joel si trova di fronte a due possibilità alternative: contribuire a salvare (forse) l’umanità da un’apocalisse in corso, o salvare una sola persona a lui molto cara, e soltanto quella. Qualunque cosa faccia o non faccia, qualcuno morirà.

Il caso descritto nell’episodio, per quanto fantascientifico ed estremo, pone un dilemma etico comune in diverse situazioni reali in cui occorre prendere una singola decisione che ha ripercussioni certe e immediate sulla vita e sulla morte delle persone. Succede spesso in ambito clinico o in guerra, per esempio, su scale più ridotte rispetto a quella della storia raccontata nella serie. L’elemento comune a tutti questi casi è tuttavia la sostanziale impossibilità di prendere una decisione che permetta di salvare tutte le persone.

L’ambientazione post-apocalittica di The Last of Us, un mondo decimato da un’infezione fungina che da decenni trasforma le persone in una specie di zombie forzuti e violenti, costringe i personaggi a prendere scelte difficili di continuo. Joel, interpretato dall’attore cileno Pedro Pascal, è un uomo burbero e risoluto incaricato di accompagnare e proteggere una ragazzina – Ellie, interpretata dall’inglese Bella Ramsey – in un lungo viaggio verso un centro di ricerca che la sta aspettando. Ellie è infatti l’unico caso noto di persona immune all’infezione: è fondamentale che sopravviva perché potrebbe fornire ai ricercatori superstiti la possibilità di sviluppare un vaccino contro l’infezione e mettere fine alla pandemia.

Ma quando i due arrivano nel centro di ricerca alla fine della prima stagione Joel scopre che l’operazione necessaria per tentare di sviluppare il vaccino implica l’uccisione della paziente, che è stata addormentata prima che potesse esprimere un eventuale consenso. A quel punto lui si trova davanti a una scelta: lasciare che Ellie muoia in una procedura medica che potrebbe (ma non c’è certezza) portare a un vaccino e salvare la vita di milioni di persone; o impedire quella procedura e continuare a proteggere Ellie, a cui nel frattempo si è affezionato come a una figlia.

Riprendendo una discussione che già appassionò il pubblico del videogioco nel 2013, molti spettatori della serie si sono chiesti sui social – senza arrivare a una posizione condivisa – se la scelta di Joel sia la più giusta tra le due. La maggior parte delle persone ha espresso una sostanziale condivisione della sua decisione, definita «quella che qualsiasi padre avrebbe preso» in una partecipata discussione su Twitter contrassegnata dall’hashtag #joeldidnothingwrong (Joel non ha fatto niente di sbagliato). Altre persone hanno invece definito quella scelta mostruosamente egoista.

– Leggi anche: Il dilemma etico dell’estinzione umana

Le valutazioni sono di solito più complicate quando riguardano casi non astratti in cui sono coinvolti i sentimenti delle persone, che è quello che capita a Joel. Come ha detto al canale NBC il docente di filosofia Steven Gimbel, che insegna al Gettysburg College in Pennsylvania, gli obblighi morali verso le persone a noi più vicine tendono a essere percepiti come prioritari rispetto a quelli nei confronti della collettività. «Di fronte alla decisione di perdere un figlio o un’altra persona cara, è probabile che sceglieremmo egoisticamente», ha detto Gimbel.

Sul piano teorico il dilemma etico di The Last of Us è una particolare variante del cosiddetto “dilemma del carrello” (trolley problem), un famoso esperimento mentale formulato nel 1967 dalla filosofa inglese Philippa Foot e alla base di un ampio genere di dilemmi a volte definito in ambito accademico con il neologismo “carrellologia” (trolleyology). Una delle caratteristiche fondamentali di questi dilemmi è che riguardano scelte che implicano il bene di qualcuno a spese del bene di qualcun altro, e che quindi possono essere percepite allo stesso tempo come comprensibili e biasimevoli a seconda della prospettiva assunta.

Gli esperimenti mentali ideati in questo ambito della filosofia morale prevedono di solito soltanto due scelte possibili, e un certo squilibrio nella quantità di persone che è possibile salvare prendendo una decisione o l’altra. Quasi tutti tendono a far emergere una tensione tra ciò che consideriamo il comportamento più giusto in termini di tutela del bene comune – in questo senso un comportamento morale – e le nostre convinzioni personali su quali azioni siano moralmente giuste e quali sbagliate in assoluto.

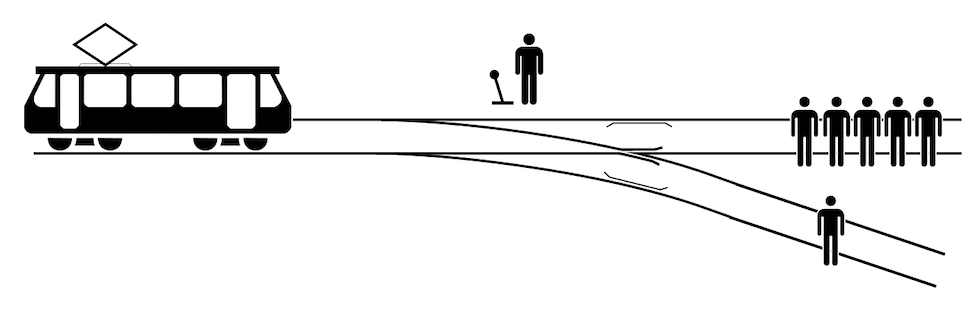

Nella sua versione più conosciuta – che è una delle tante, e ciascuna con differenti sfumature e implicazioni – il dilemma del carrello pone il soggetto in una situazione immaginaria in cui può decidere, azionando una leva, la vita o la morte di altre persone. Nello specifico gli è permessa soltanto un’azione: può deviare o non deviare il percorso di un carrello ferroviario che è diretto verso cinque persone bloccate su un binario. Se aziona la leva, il carrello si dirigerà verso un altro binario su cui si trova bloccata una sola persona. Se non aziona la leva, il carrello investirà le cinque persone sul primo binario.

(McGeddon/Wikimedia)

In una seconda versione del dilemma, ideata negli anni Ottanta dalla filosofa statunitense Judith Jarvis Thomson sull’esempio di Foot, il binario è uno soltanto ma il soggetto dell’esperimento può impedire che il carrello investa le cinque persone spingendo giù da un ponte sul binario un uomo di grandi dimensioni. L’uomo morirà, ma il suo corpo fermerà la corsa del carrello salvando la vita di cinque persone.

In entrambi i casi, non intervenendo, cinque persone muoiono, senza però un ruolo attivo del soggetto che sta facendo il test. In alternativa, il soggetto può intervenire direttamente e intenzionalmente provocando la morte di una persona, ma salvando le altre cinque. Con un bilancio quindi positivo di quattro persone morte in meno.

Nella maggior parte dei casi le persone pensano che sia giusto – o addirittura doveroso: un obbligo morale – azionare la leva nel primo dilemma, ma che non sarebbe giusto buttare la persona giù dal ponte nel secondo. Come spiega il filosofo statunitense David Edmonds nel libro del 2013 Uccideresti l’uomo grasso? Il dilemma etico del male minore, una delle più citate e complete analisi recenti delle questioni poste dal dilemma del carrello, la differenza nella risposta alle due versioni del dilemma è dovuta a una distinzione percepita dalle persone – e familiare a molte che lavorano in ambito medico – tra l’immoralità dei danni «intenzionali» e l’accettabilità dei danni «previsti».

La distinzione tra intendere e prevedere è centrale nella cosiddetta “dottrina del duplice effetto”, teorizzata nel XIII secolo dal filosofo italiano Tommaso d’Aquino e argomento dell’articolo di Foot del 1967 in cui fu presentata una prima versione del dilemma del carrello. Secondo la teoria di Tommaso d’Aquino l’uccisione di una persona non è mai moralmente ammissibile, a meno che non sia l’effetto involontario di un’azione la cui intenzione sia buona (l’autoconservazione della propria vita, per esempio). E a condizione che quell’azione generi effetti positivi superiori a quelli negativi: «Un atto che parte da una buona intenzione può diventare illecito se è sproporzionato al fine», scrisse Tommaso d’Aquino nel suo trattato più famoso, la Somma teologica.

– Leggi anche: “Panta rei” non vuol dire quello che sembra

L’intenzione è così importante nella dottrina del duplice effetto che anche l’autorità pubblica, l’unico soggetto a cui spetti secondo Tommaso d’Aquino la responsabilità di uccidere un aggressore non per autodifesa ma per il bene comune, farebbe qualcosa di moralmente sbagliato se nell’uccidere quell’aggressore fosse «mossa da risentimenti personali».

Un approccio diverso ai dilemmi etici, di tipo consequenzialista, rifiuta di definire valori morali a priori e si concentra invece soltanto sulle conseguenze dell’azione, dal momento che azioni con conseguenze simili possono derivare da intenzioni differenti ed essere quindi moralmente diverse sotto l’aspetto dell’intenzione. Ciò che conta, in altre parole, sono soltanto le conseguenze dell’azione, considerata buona se produce la massima felicità per il maggior numero di persone, secondo una formulazione attribuita al filosofo inglese del Settecento Jeremy Bentham ma ampiamente nota e diffusa in tutta la cultura illuministica.

Riprendendo invece Tommaso d’Aquino ed esplicitando alcuni passaggi della Somma teologica, Foot approfondì la distinzione tra ciò che può essere previsto come risultato secondario di una propria azione volontaria, e ciò che invece viene intenzionalmente perseguito. E sostenne che sulla base della dottrina del duplice effetto certe azioni possano essere considerate lecite perché il risultato secondario che provocano, per quanto messo in conto, non era l’obiettivo dell’azione.

Foot propose una serie di esperimenti mentali, tra cui il dilemma del carrello, proprio per chiarire queste distinzioni e mostrare come in molte situazioni siano influenti per le valutazioni delle persone, anche a livello inconscio.

Un altro dilemma proposto da Foot è utile a descrivere e capire meglio l’approccio prevalente al dilemma del carrello, in cui a molte persone sembra giusto azionare la leva per salvare cinque persone, anche se questo implica la morte di un’altra persona. Foot immagina che una dose di un certo farmaco possa salvare o la vita di una persona, a cui serve tutta la dose, o quella di altre cinque persone, a cui basta solo un quinto della dose a testa. Come nel dilemma del carrello, le persone considerano moralmente ammissibile salvare cinque persone e lasciare morire l’altra. Inoltre, a differenza del caso del carrello, se non venisse presa alcuna decisione morirebbero tutte e sei le persone che hanno bisogno del farmaco.

L’attitudine delle persone cambia completamente nel caso di un altro dilemma immaginato da Foot, un po’ diverso. Cinque pazienti molto malati hanno urgente necessità di un trapianto di organi, altrimenti moriranno nel giro di poche ore: a due persone servono un rene ciascuna, ad altre due un polmone ciascuna e a un’altra serve un cuore. Il sangue e gli altri valori di un giovane uomo in ottima salute risultano del tutto compatibili con quelli dei pazienti. Il chirurgo può o uccidere quell’uomo per prelevare gli organi necessari e impiantarli nei pazienti in attesa, o lasciare in pace quell’uomo e lasciar morire i pazienti: di solito la prima scelta è considerata non soltanto ingiusta ma spregevole.

Secondo Foot reagiamo ai due esperimenti in modo così diverso perché abbiamo sia «doveri negativi» che «doveri positivi», e tendiamo ad agire sotto l’influsso di entrambi. Un obbligo negativo è il dovere di non interferire nella vita di altre persone – uccidendole, per esempio – e uno positivo è il dovere di aiutare gli altri.

– Leggi anche: Negli Stati Uniti c’è un certo interesse per l’“altruismo efficace”

La differenza sostanziale tra il dilemma del carrello e quello del trapianto, scrive Edmonds in Uccideresti l’uomo grasso?, è che nel primo dilemma non abbiamo intenzione di uccidere la persona sul binario, ma nel secondo abbiamo intenzione di uccidere la persona in buona salute i cui organi salveranno cinque vite. Per assurdo, modificando la direzione del treno, la persona bloccata sul binario potrebbe magari riuscire anche a slegarsi in qualche modo e mettersi in salvo. Ma nel caso del trapianto la morte di una persona è necessaria, perché è il mezzo per salvare le altre cinque.

Secondo Edmonds, sebbene non siano mai stati del tutto risolti dal punto di vita filosofico e possano sembrare ad alcune persone un esercizio inutile, gli esperimenti mentali servono a scoprire predisposizioni e valori largamente condivisi dalle persone ma spesso soltanto a livello intuitivo. E per quanto immaginari questi esperimenti possono contribuire a sviluppare principi di qualche utilità pratica «in un mondo in cui devono essere fatte scelte reali, e sono persone reali a potersi far male» o a morire.

Gli esperimenti mentali sono utilizzati, tra le altre cose, in ambito militare. Edmonds cita come esempio l’accademia militare statunitense di West Point, a nord di New York, dove i dilemmi di carrellologia sono parte di un corso obbligatorio di filosofia nell’addestramento dei futuri ufficiali. La distinzione tra intenzione e previsione è considerato dagli addestratori un criterio molto rilevante perché contribuisce a individuare e definire meglio, per esempio, le differenze tra operazioni che prendono di mira un’installazione militare, pur nella consapevolezza che alcuni civili saranno coinvolti nell’attacco in modo inevitabile, e operazioni che prendono deliberatamente di mira i civili.

Da tempo i dilemmi etici sono inoltre parte della coscienza popolare, come dimostrano molte circostanze in cui diventano spunto di dibattito. Nel 2009, durante una conferenza TED dell’allora primo ministro britannico Gordon Brown, l’intervistatore Chris Anderson gli propose un esperimento mentale. Gli chiese cosa avrebbe fatto se, trovandosi su una bella spiaggia, si fosse sparsa la voce di uno tsunami in arrivo sulla costa e lui avesse avuto soltanto il tempo di avvisare o una famiglia composta da cinque nigeriani a un’estremità della spiaggia, o una famiglia composta soltanto da un inglese all’estremità opposta. «Allerto entrambe le famiglie», rispose Brown eludendo la domanda, tra le risate del pubblico.

In diverse circostanze non è possibile salvare tutti, ricorda Edmonds. I politici, così come le autorità sanitarie, devono prendere decisioni che sono «questione di vita o di morte» in situazioni in cui le risorse sono limitate. Molte questioni difficili da risolvere si presentano più o meno come una specie di variante del dilemma del carrello, anche se nella maggior parte dei casi non implicano l’uccisione di nessuno. È un dilemma etico, per esempio, qualsiasi scelta di un’istituzione sanitaria tra finanziare un farmaco che si stima possa salvare un certo numero di vite e un altro che potrebbe salvarne di più o di meno. Ed è un dilemma rispetto al quale il numero di potenziali pazienti interessati non è l’unica variabile né necessariamente la più importante da tenere in considerazione.

– Leggi anche: La scienza non è “neutra”

In tempi recenti le implicazioni dei dilemmi etici e dei diversi modi di risolverli sono poi diventate ancora più evidenti e comprensibili in una situazione straordinaria: la pandemia, che ha portato politici e autorità sanitarie a dover affrontare dilemmi per alcuni aspetti molto simili e per altri molto diversi da quello immaginario raccontato in The Last of Us. Dal paragone tra realtà e finzione emerge prima di tutto una differenza fondamentale: a voler rispettare i criteri etici della ricerca sugli esseri umani, un caso come quello della serie sarebbe attualmente impensabile.

Come ha spiegato al sito Vox il docente di bioetica statunitense Arthur Caplan, capo del dipartimento di etica medica presso la NYU Grossman School of Medicine, ragionando per assurdo, se anche qualcuno si offrisse come volontario per partecipare a un esperimento fondamentale per la ricerca ma letale per il soggetto, la sua richiesta non potrebbe essere accolta in nessun caso. La sua morte peserebbe più di qualsiasi altra variabile nell’analisi del rapporto tra rischi e benefici, per come sono strutturati i comitati etici indipendenti di revisione della ricerca scientifica (quello che in inglese è definito Institutional review board, IRB, che analizza e valuta procedure e metodi della ricerca per assicurarsi che i diritti degli esseri umani siano rispettati).

Questo non significa che non ci siano casi limite in cui rischi molto significativi per i soggetti dell’esperimento sono da molte persone considerati accettabili in rapporto ai benefici per la ricerca. Un esempio recente fu la proposta circolata all’inizio della pandemia – e condivisa anche da Caplan, tra gli altri – di accelerare la sperimentazione sul vaccino infettando individui sani con il coronavirus, in una fase in cui rischiavano di sviluppare una malattia per cui non esistevano cure.

Non è detto quindi che i criteri etici di valutazione della ricerca scientifica rimarrebbero uguali a quelli attuali in un ipotetico scenario apocalittico come quello di The Last of Us, in cui centinaia di milioni di persone muoiono (o meglio: si trasformano) da vent’anni.

– Leggi anche: Cosa c’è di scientificamente plausibile nella serie “The Last of Us”

In ogni caso altre variabili da considerare per risolvere il dilemma etico sarebbero molto rilevanti, forse più di quanto non sembri nella serie, secondo Caplan. Una di queste variabili sarebbero le probabilità di successo della procedura, che in parte influenzano sempre la risposta al dilemma. Nella serie non è detto che la morte di Ellie porti poi alla fine della pandemia: incertezza che probabilmente rafforza le ragioni di Joel. Nel dilemma del trapianto sarebbe come uccidere la persona in salute e non riuscire comunque a salvare nessuno dei cinque pazienti in attesa dei suoi organi.

Un’altra variabile sarebbe la consapevolezza del soggetto dell’esperimento e la piena comprensione dei rischi in base alle informazioni ricevute. Non basterebbe una generica predisposizione altruistica verso il mondo e le altre persone: servirebbe un consenso esplicito. Esistono casi in cui questo consenso può essere presunto, ha detto Caplan, ma non sembrano casi tanto compatibili con quello di Ellie.

Caplan ha fatto l’esempio di una persona che sia trasportata in pronto soccorso priva di sensi dopo aver mangiato un fungo velenoso. In mancanza di una cura e del tempo necessario per coinvolgere il comitato etico, a fronte di una morte certa e imminente per avvelenamento, è possibile avviare una cura sperimentale senza il consenso del paziente, presupponendo che la maggior parte delle persone fornirebbe quel consenso (che comunque viene poi richiesto e ottenuto a cose fatte, se il paziente sopravvive).

È comunque probabile che, nel caso di una pandemia tanto estesa e mortale come quella di The Last of Us, la scala del problema finisca per essere una delle variabili più influenti nel dilemma etico, secondo Caplan, che sembra propendere per un approccio utilitarista (più concentrato cioè sull’utilità immediata e futura delle azioni, a prescindere dalle intenzioni).

A questo proposito Caplan ha ricordato il dibattito sulla tortura, considerata da molte persone uno strumento inaccettabile, e un crimine in diverse legislazioni nazionali e internazionali. Il suo uso tende tuttavia a essere a volte legittimato da alcune persone a seconda delle variabili prese in considerazione e della scala del problema che si tenta di risolvere.

Caplan ha premesso di non essere favorevole alla tortura, ma ha aggiunto che è possibile immaginare esperimenti mentali in cui le valutazioni di chi è contrario potrebbero anche cambiare. Per esempio, se una persona avesse piazzato un’arma nucleare e sapessimo per certo che quella bomba farà esplodere una città, in mancanza di altri modi per ottenere una risposta da quella persona su dove l’arma sia stata piazzata, in modo da disinnescarla, la tortura potrebbe essere considerata uno strumento meno inaccettabile di quanto lo sia normalmente: «perché i numeri contano», ha detto Caplan.

– Leggi anche: Come risolvi i gravi dilemmi etici, se hai due anni