Le intelligenze artificiali saranno nazionalizzate?

L'aggressività del governo Trump l'ha resa un'ipotesi sempre più presente nel dibattito, che preoccupa sia chi guida le aziende sia chi le studia

di Pietro Minto

«Cosa succede se il governo prova a nazionalizzare OpenAI o altri progetti di intelligenza artificiale?» si è chiesto qualche giorno fa Sam Altman, capo di OpenAI, pubblicando un lungo post su X in cui ha parlato, tra le altre cose, della crescente influenza del governo statunitense nel settore dell’intelligenza artificiale (AI).

La prospettiva della nazionalizzazione, con cui si intende il trasferimento della proprietà o del controllo di un’azienda allo Stato, si inseriva in un dibattito già in corso sui rapporti tra governo e industria delle AI. Nei giorni precedenti, il Pentagono – cioè il dipartimento della Difesa degli Stati Uniti – si era infatti scontrato con Anthropic, l’azienda produttrice del chatbot Claude, dopo che quest’ultima si era rifiutata di mettere le sue AI a disposizione del dipartimento in due casi particolari (la sorveglianza di massa domestica e i sistemi d’arma autonomi).

Il Pentagono aveva reagito classificando l’azienda come un “supply-chain risk”, cioè un rischio per la sicurezza nazionale. Negli stessi giorni OpenAI aveva approfittato della situazione per firmare un proprio contratto con il Pentagono, scatenando polemiche anche all’interno dell’azienda, tanto che lo stesso Altman aveva poi dovuto rassicurare che il nuovo accordo aveva limiti simili a quelli richiesti da Anthropic.

A far discutere, però, è stato soprattutto l’approccio aggressivo del segretario alla Difesa Pete Hegseth, che ha cercato di influenzare le aziende tecnologiche minacciando ripercussioni in caso di mancata collaborazione. Visto che tra i sistemi di cui si parla ci sono anche i cosiddetti AGI, le intelligenze artificiali – per ora solo ipotetiche – così avanzate da sfuggire potenzialmente al controllo dei loro creatori, la prospettiva che il Pentagono se ne appropri d’imperio ha generato preoccupazioni e riaperto il dibattito sul giusto ruolo che i governi dovrebbero avere nello sviluppo delle AI.

C’è infatti chi ritiene che dovrebbe essere lo Stato a occuparsi di tecnologie così potenti e sensibili, prendendo il controllo delle aziende che producono le AI attraverso una forma di nazionalizzazione. I sostenitori di questa posizione citano spesso il caso della bomba atomica, che fu inizialmente sviluppata da un progetto militare (il progetto Manhattan) per passare, dal 1947, sotto la gestione dell’Atomic Energy Commission, un ente governativo.

Già nel 2023, Charles Jennings, un imprenditore del settore AI, scrisse su Politico che la nazionalizzazione delle AI era l’unico modo per controllare lo sviluppo di sistemi «così veloci, intelligenti ed efficienti che il loro comportamento diventa pericolosamente imprevedibile».

– Leggi anche: Che ne è stato della cautela nel settore delle intelligenze artificiali?

A inizio marzo anche Alex Karp, capo di Palantir, controversa azienda di analisi di dati che lavora con molti governi e forze di polizia, ha sostenuto che le AI finiranno inevitabilmente per essere nazionalizzate, perché le stesse aziende che stanno automatizzando sempre più professioni pretendono di poter anche dettare le proprie condizioni al Pentagono. «Se non pensate che questo porterà alla nazionalizzazione della nostra tecnologia, siete dei ritardati», ha detto testualmente Karp.

Per ora, però, il rischio più concreto è che il governo statunitense aumenti il controllo in questo settore per questioni politiche, usando il tema della sicurezza come pretesto per influenzare queste aziende. Anche prima del recente scontro tra Pentagono e Anthropic, infatti, l’amministrazione Trump aveva criticato e fatto pressioni sull’azienda perché ritenuta troppo «cauta» nello sviluppo delle AI.

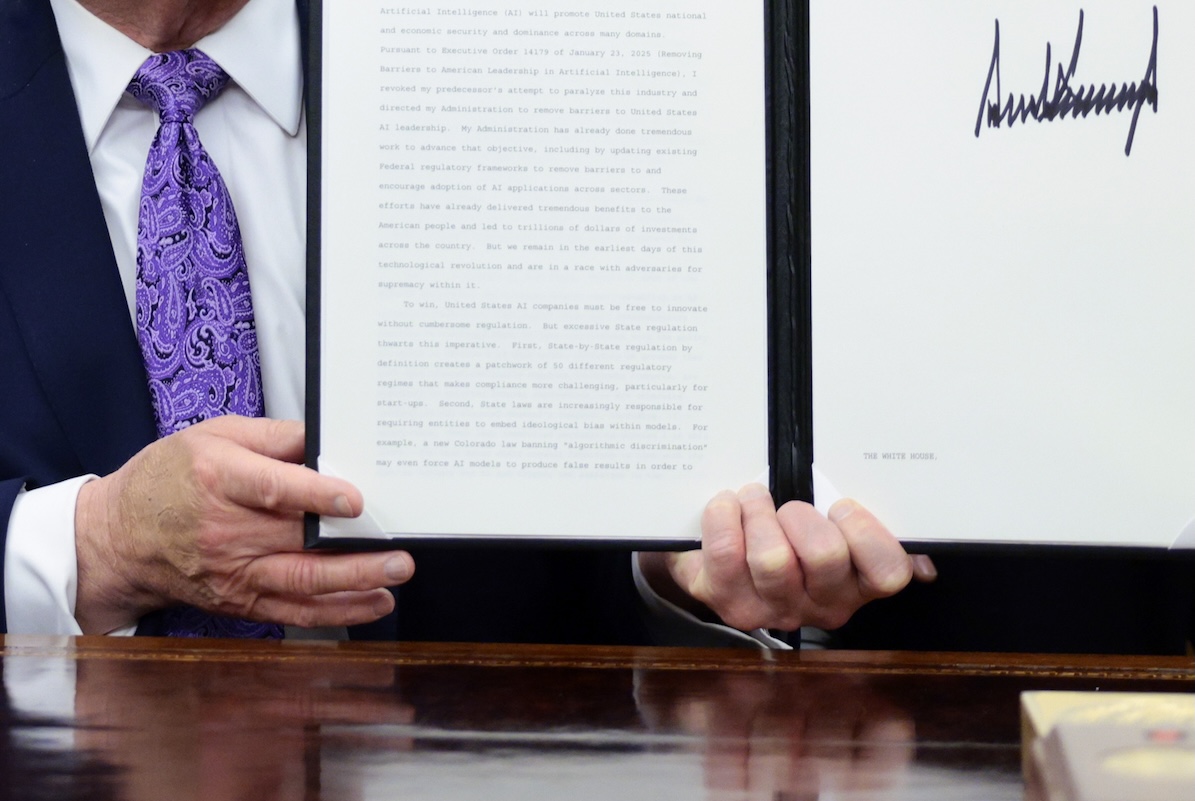

Questa strategia rientra nella più ampia alleanza tra movimento trumpiano e settore tecnologico, che ha spinto l’amministrazione ad adottare una politica molto permissiva, ostacolando i tentativi da parte dei singoli stati di regolamentare le AI. Questa mancanza di regole rappresenta un enorme vantaggio per le aziende statunitensi che si occupano di AI, ma al tempo stesso le lascia prive di protezioni formali contro le pressioni politiche del governo, come ha dimostrato il caso di Anthropic.

Secondo Alessandro Aresu, consigliere scientifico della rivista Limes e autore del saggio Geopolitica dell’intelligenza artificiale, per nazionalizzare le AI Trump potrebbe forzare i meccanismi del Defense Production Act. Si tratta di una legge approvata nel 1950, all’inizio della guerra in Corea, che permette al presidente degli Stati Uniti di identificare alcune risorse come «critiche e strategiche», e di garantirne la disponibilità prioritaria per le esigenze nazionali. Del resto, nota Aresu, con questa amministrazione «gli interventi del governo in capitali di aziende, come Intel o le società minerarie, sono aumentati in modo considerevole».

Alla guerra di Corea risale anche un altro precedente storico importante, quello con cui il presidente dell’epoca, Harry Truman, ordinò al governo federale di prendere il controllo delle principali acciaierie del paese per evitare cali di produzione in caso di sciopero dei lavoratori. Le aziende fecero ricorso e la Corte Suprema, nel 1952, stabilì che Truman aveva ecceduto i propri poteri presidenziali, proprio perché mancava una legge che permettesse espressamente quel tipo di intervento.

«Alcuni aspetti specifici del settore dell’intelligenza artificiale potrebbero essere usati dal governo per dire che stavolta è diverso e la questione andrebbe comunque alla Corte Suprema», dice Aresu, che ricorda come già oggi il caso di Anthropic sia piuttosto rilevante e dibattuto anche tra gli esperti del settore.

– Leggi anche: L’intelligenza artificiale è una bolla?

C’è poi un altro tipo di intervento statale, il cosiddetto “backstop” (letteralmente “rete di protezione”), con cui il governo si fa garante degli investimenti di un’azienda. Lo scorso novembre Altman aveva dovuto smentire le dichiarazioni della direttrice finanziaria di OpenAI Sarah Friar, che a un evento del Wall Street Journal aveva lasciato intendere che il governo potesse sostenere finanziariamente gli investimenti dell’azienda, al pari di banche e investitori privati. Secondo Aresu, è un precedente importante perché dimostra come alle volte siano le aziende stesse a richiedere un intervento statale diretto, invece di subirlo.

Secondo Francesca Lagioia, professoressa di Informatica giuridica all’Università di Bologna e allo European University Institute di Firenze, la nazionalizzazione è uno scenario preoccupante per due ragioni principali: limiterebbe la ricerca e la cooperazione scientifica internazionale, e non risolverebbe il problema della concentrazione di potere, spostandolo semplicemente dal settore privato a quello pubblico. Inoltre, dice Lagioia, il confronto con la bomba atomica, spesso evocato dai sostenitori della nazionalizzazione, non regge: «Nel caso del nucleare, il controllo funzionò perché la tecnologia era estremamente difficile da replicare e dipendeva da risorse materiali rare», mentre nelle AI le competenze scientifiche e le infrastrutture sono diffuse globalmente.

Persino il governo cinese, che ha un controllo piuttosto diretto delle industrie locali, non possiede le aziende ma impone regole a cui attenersi: «In Cina le imprese restano imprese, ma operano in un ambiente dove l’autonomia strategica nei confronti del potere politico è limitatissima», spiega Lagioia. Tuttavia, il progresso tecnologico cinese viene spesso usato dalle aziende della Silicon Valley come argomento contro qualsiasi regolamentazione: normare il settore, sostengono, rischierebbe di rallentarlo, favorendo la Cina in una tecnologia considerata cruciale per il futuro della sicurezza nazionale.

– Leggi anche: Stiamo appaltando la verità all’AI

Il dibattito sulla nazionalizzazione delle AI è stato finora perlopiù accademico o speculativo. Di conseguenza, queste proposte spesso non tengono conto degli enormi costi associati a un processo simile, specie se si considera che le aziende di AI hanno tra le valutazioni più alte del mondo, nell’ordine delle centinaia di miliardi di dollari. La maggior parte di loro, inoltre, è impegnata da alcuni anni in enormi investimenti nella costruzione di nuovi data center, che rappresentano da soli un giro d’affari così grande da trainare, secondo alcuni, l’economia statunitense.

Qualunque governo provasse ad aumentare il proprio controllo nel settore, quindi, rischierebbe di causare conseguenze economiche imprevedibili. Anche per questo, il modello di intervento più probabile per gli Stati Uniti, secondo Lagioia, è quello “tramite procurement e difesa”, un sistema utilizzato perlopiù nel campo militare e della sicurezza nazionale, in cui lo Stato usa gli enormi contratti e appalti pubblici per diventare il principale acquirente delle aziende del settore. In questo modo, può far valere la propria influenza su di loro senza per forza prenderne il controllo.

Un esempio di approccio più normativo, invece, è quello europeo, in cui le istituzioni impongono obblighi e regole rigide, definendo il perimetro operativo del comparto, anche attraverso poteri di ispezione, sospensione e interdizione. È il caso dell’Ufficio europeo per l’Intelligenza Artificiale, fondato nel 2024, che sorveglia in particolare i modelli general-purpose (cioè quelli pensati per avere il più alto numero di applicazioni, dalla generazione di immagini a quella di codice informatico), considerati a più alto rischio sistemico, e ha la facoltà di richiedere informazioni o misure correttive alle aziende in questione. Secondo Lagioia, questo rappresenta un esempio di come una governance forte possa ottenere risultati senza per forza controllare le aziende AI: «L’Europa non dice “nazionalizziamo” ma “costituzionalizziamo” l’AI dentro un regime di obblighi, sorveglianza e sanzioni».

L’efficacia di questo modello è però limitata dal fatto che l’industria europea delle AI è molto più piccola e meno dominante di quella statunitense o cinese. Sul piano regolatorio, quindi, l’Unione europea avrebbe gli strumenti per controllare le AI senza ricorrere a nazionalizzazioni; il problema è che l’intero settore opera altrove, in paesi che non hanno intenzione di seguire l’approccio europeo.

– Leggi anche: Il post virale che fa previsioni dirompenti sull’AI