È pieno di video falsi sulla guerra in Medio Oriente

Vecchi, incongrui o realizzati con l'intelligenza artificiale, riconoscerli è difficile e a volte fanno milioni di visualizzazioni

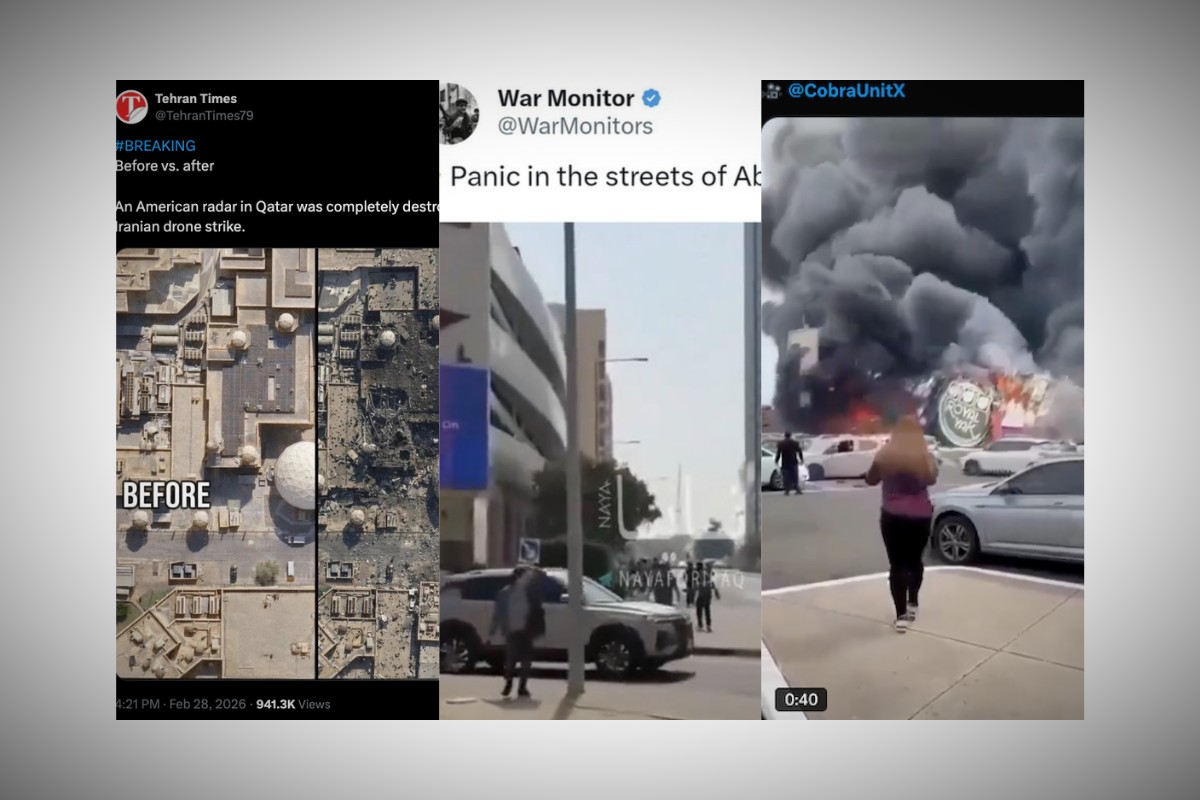

Un post condiviso su X sabato 28 febbraio diceva di mostrare il fuoco e il fumo provocati da un attacco missilistico contro una base militare israeliana. Il post era stato condiviso nelle ore dei primi attacchi di Stati Uniti e Israele contro l’Iran, e di quelli lanciati in risposta dall’Iran: in pochissimo tempo aveva ottenuto oltre 200mila visualizzazioni, ma il problema è che non mostrava né fatti di quel giorno e nemmeno emergenze in corso in Israele, bensì un’esplosione avvenuta a metà gennaio in un casinò di Culiacán, in Messico.

È solo uno dei moltissimi esempi di video falsi, fatti con l’intelligenza artificiale oppure riproposti dal passato, che stanno proliferando sui social e contribuendo alla disinformazione su quello che sta succedendo in Medio Oriente.

Martedì pomeriggio sempre su X ha avuto milioni di visualizzazioni un video che dice di mostrare un massiccio bombardamento su Tel Aviv: con esplosioni e danni che sarebbero incredibili, se non fosse che non sono avvenuti. Nonostante sia realizzato con l’AI, il chatbot di X Grok, interpellato dagli utenti per conferme, ha assicurato che è vero (e in altre conversazioni, che invece è falso). Capita spesso che sbagli nel riconoscere i video fatti dall’AI, in teoria una delle ragioni principali per cui viene utilizzato. Nel giro di alcune ore, il video è stato poi rimosso dal profilo che lo aveva condiviso, ma in giro si può trovare ancora.

Il video falso sul bombardamento a Tel Aviv

Shayan Sardarizadeh, giornalista di BBC Verify, la sezione dell’emittente britannica che si occupa di combattere la disinformazione, ha raccolto alcuni di questi video per far capire quanto, nell’enorme quantità di immagini e dati confusi e parziali che ci stanno raggiungendo man mano, sia facile prenderli per veri anche se non lo sono. Lo stesso hanno fatto altri esperti, così come la rivista di tecnologia Wired o il sito specializzato AAP FactCheck, che fa parte del Network internazionale di fact-checking (IFCN).

Un video con oltre 5 milioni di visualizzazioni sembra mostrare presunti missili balistici sul cielo di Dubai, negli Emirati Arabi Uniti, quando dalle analisi svolte risultano essere missili iraniani fotografati nell’ottobre del 2024 diretti verso Tel Aviv, in Israele. Certe immagini invece sono state generate con l’intelligenza artificiale, come quella che mostra Ali Khamenei, la Guida Suprema dell’Iran, morto sotto le macerie di un edificio: le autorità iraniane hanno confermato la sua uccisione, ma a oggi non sono state diffuse foto credibili del suo corpo.

È ormai normale che durante eventi particolarmente discussi o polarizzanti i social si riempiano di disinformazione. È accaduto all’inizio dell’invasione israeliana della Striscia di Gaza, e più di recente con le proteste contro le discusse operazioni dell’agenzia anti-immigrazione negli Stati Uniti. Nel caso della guerra tra Stati Uniti e Israele da un lato, e Iran dall’altro, ambo le parti hanno interesse a promuovere immagini che impressionino il pubblico e convincano dei rispettivi successi, presunti o tali.

Anche un account che sostiene il presidente statunitense Donald Trump, per esempio, ha condiviso le presunte foto del palazzo in cui si sarebbe trovato Khamenei durante il bombardamento che lo ha ucciso a Teheran, prima e dopo. Anche se la seconda mostra effettivamente il palazzo dopo l’attacco, la prima è di un altro edificio: il mausoleo di Ruhollah Khomeini, che si trova dall’altra parte della città. In certi casi poi i contenuti nascono dalla manipolazione di immagini satellitari, come quelle disponibili su Google Earth, e in altri sono addirittura tratti da videogiochi.

Il fenomeno sta interessando in particolare X, che da quando è controllato da Elon Musk si è riempito di contenuti violenti e razzisti, che promuovono notizie false o teorie del complotto e incitano all’odio. È un tema su cui ormai da tempo sono in corso dibattiti e riflessioni, anche perché alcuni studi scientifici hanno evidenziato che i video falsi possono influenzare quello che le persone pensano anche quando sanno che sono falsi.

Ci sono comunque modi per cercare di capire se un video, un’immagine o un contenuto audio è stato generato oppure alterato con modelli di intelligenza artificiale, sempre con le dovute cautele. Si può per esempio usare la verifica SynthID di Google, uno strumento disponibile tramite Gemini, l’assistente AI di Google, o Hive Moderation, che aiuta a capire l’origine di un’immagine. Spesso, tuttavia, forniscono risposte con gradi di certezza insufficienti.

Su X invece non bisogna pensare che gli account con la spunta blu siano affidabili: anzi, sono tra quelli che più fanno ricircolare video fatti con l’AI. Il motivo è che pagano per avere un profilo premium e guadagnano in base alle interazioni che creano, indipendentemente dalla qualità dei contenuti. Sotto ai post di X possono comparire le cosiddette note della community, ovvero avvisi nati dalle segnalazioni degli stessi utenti che li contrassegnano come contenuti falsi o fuorvianti. Però spesso appaiono solo dopo molte segnalazioni, e magari dopo che i post hanno già ottenuto moltissime visualizzazioni.

Lo stesso Grok è responsabile di molte falsità che girano su X. Oltre ad aver avvalorato i video falsi dei bombardamenti su Tel Aviv, in questi giorni ha descritto il video di una folla di persone presumibilmente radunata per una commemorazione di Khamenei domenica primo marzo sia come autentico, sia come relativo a un evento del 2020.

– Leggi anche: La disinformazione è un problema diverso da come lo immaginiamo