Quanti tipi di probabilità!

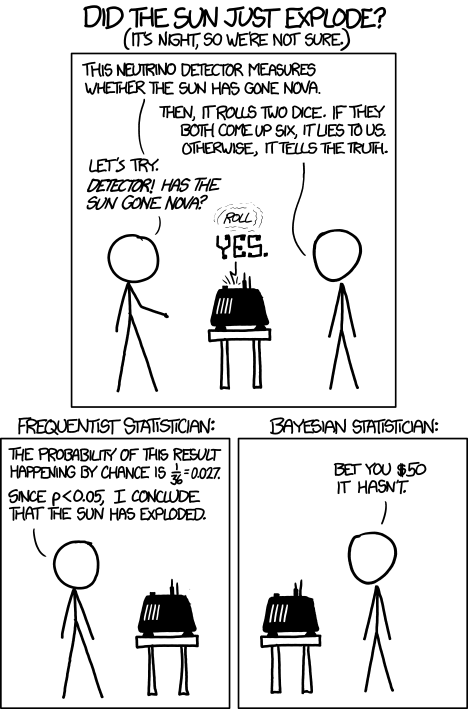

La vignetta odierna di xkcd mostra, con il solito umorismo di Randall Munroe, come si possono avere due idee completamente diverse di probabilità.

Per chi non è troppo a suo agio con l’inglese, ecco una traduzione alla bell’e meglio.

Titolo: “È appena esploso il sole? (è notte, non possiamo esserne certi)”

F: Questo rivelatore di neutrini misura se il sole è diventato una nova.

B: Poi lancia due dadi: se escono due sei, darà una risposta errata, altrimenti darà quella corretta.

F: Proviamoci. “Rivelatore! Il sole è diventato una nova?”

R: (lancio di dadi) sì

Lo statistico frequentista F: La probabilità che questo risultato sia dovuto al lancio dei dadi e`1/36, cioè il 2,7% circa. Visto che è minore di p=5%, concludo che il sole è esploso.

Lo statistico bayesiano B: Scommetto cinquanta dollari che non è esploso.

Detto così si capisce poco o nulla, mi sa, a meno che non sappiate qualcosa in più su come funziona il concetto di probabilità, o meglio di come le persone lo considerino. Solo che già è difficile che si parli di probabilità a scuola, figuriamoci della filosofia della probabilità… ma niente paura, ghe pensi mi!