Quanto fidarsi delle AI per la nostra salute

Saranno sempre più usate per fare diagnosi e prescrivere terapie, ma che succede se si inventano malattie o parti anatomiche?

Analizzando le immagini di una TAC al cervello, un’intelligenza artificiale di Google si è inventata una parte anatomica che non esiste, scrivendo un referto che è stato poi inserito in una ricerca scientifica proprio sull’utilità delle AI per fare le diagnosi mediche. L’errore è stato notato da un neurologo che non aveva partecipato allo studio ed è stato corretto solo parzialmente da Google, che ha provato a minimizzarne la portata. La vicenda, ripresa da diversi siti di tecnologia e di salute, è emblematica del modo in cui l’intelligenza artificiale, pur mostrando grandi potenzialità nel campo medico, può generare risultati fuorvianti se non adeguatamente supervisionata.

Oltre a scrivere testi, disegnare, modificare immagini e comporre musica, si prevede che i sistemi di intelligenza artificiale (AI) saranno sempre più utilizzati in numerosi ambiti lavorativi, compreso quello sanitario. Alcuni dei più grandi sviluppatori, come OpenAI e Google, sostengono da diverso tempo che le loro AI possano essere usate non solo nello sviluppo di nuovi farmaci, ma anche per aiutare i medici a fare diagnosi più precise e accurate. Intorno a questa possibilità ci sono grandi opportunità ed entusiasmi, ma diversi medici ed esperti di AI invitano a una certa prudenza e a riconoscere i limiti che hanno le attuali applicazioni per fare diagnosi.

Da più di un anno Google promuove i progressi e i risultati ottenuti da Med-Gemini, un insieme di modelli multimodali (cioè che combinano più cose, come le informazioni da immagini, testi e altre fonti) specializzati in medicina. È un sistema che può riassumere testi medici, valutare i sintomi segnalati da un paziente per provare a fare una diagnosi ed è anche in grado di analizzare le immagini come quelle delle radiografie, delle TAC e delle risonanze magnetiche, rilevando anomalie e segnalandole ai medici. Quest’ultimo compito è assolto da diverse altre AI già disponibili da qualche tempo e si è rivelato molto promettente, con test nei quali i sistemi di analisi delle immagini hanno talvolta visto cose che non erano state osservate dai radiologi. Ma non sempre le cose vanno per il verso giusto.

Le AI possono infatti avere allucinazioni e segnalare quindi qualcosa che non esiste, o inventarsi di sana pianta una parte anatomica, con tutti i rischi che possono conseguirne nel caso di valutazioni poco attente da parte dei medici che utilizzano questi software. Med-Gemini lo ha fatto creando un pezzo del cervello che non esiste e che è finito poi in uno studio scientifico, che raccontava proprio i progressi raggiunti da quella AI.

Per comprendere il problema occorre una rapida lezione di anatomia. I gangli della base (“basal ganglia” in inglese) sono una struttura del cervello formata da neuroni che si trova alla base del cervello ed è coinvolta in numerose funzioni come il controllo dei movimenti, l’apprendimento e la gestione delle emozioni, mentre l’arteria basilare (“basilar artery”) è un vaso sanguigno che porta il sangue a numerose strutture del cervello. Hanno quindi funzioni molto diverse e di conseguenza richiedono trattamenti diversi a seconda dei problemi che potrebbero avere.

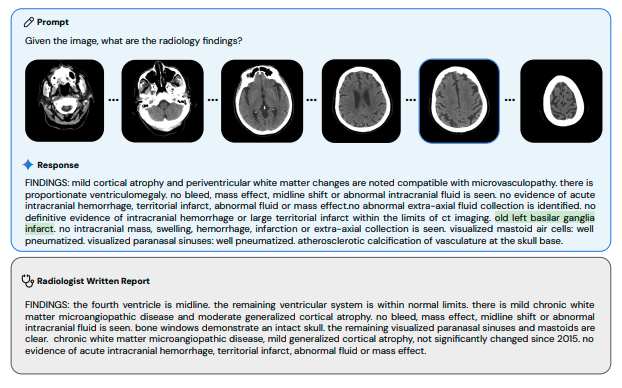

L’allucinazione di Med-Gemini è consistita nell’invenzione dei “gangli basilari” (“basilar ganglia” in inglese), una parte anatomica che non esiste. L’errore non era stato notato né da chi aveva rivisto il referto, né da chi aveva poi preparato lo studio scientifico sulle capacità della AI di Google in ambito medico. I “gangli basilari” erano finiti anche sul blog ufficiale dell’azienda nel maggio del 2024, in un articolo divulgativo che illustrava i punti principali dello studio in modo da mettere in risalto i progressi ottenuti con la nuova AI.

La parte dello studio che illustra le capacità di Med-Gemini con i “gangli basilari”

Come ha raccontato il sito di tecnologia The Verge, l’errore era stato notato in seguito da un neurologo che aveva svolto alcune ricerche con le AI. Aveva avvisato Google, che aveva modificato l’articolo divulgativo senza però segnalare di avere corretto l’errore, che continuava inoltre a essere presente sullo studio scientifico.

Il neurologo segnalò pubblicamente che l’articolo era stato corretto senza una nuova indicazione e solo a quel punto Google lo modificò nuovamente, aggiungendo una spiegazione che avrebbe comunque lasciato perplessi diversi medici: «Si noti che “basilare” è un comune errore di trascrizione della parola “basale” che Med-Gemini ha appreso dai dati usati per il suo addestramento, anche se il significato del suo referto rimane il medesimo». Per Google si trattava quindi più di un refuso che di un’allucinazione.

Se si usa uno dei principali motori di ricerca per studi scientifici, come Google Scholar, le occorrenze per “basilar ganglia” sono meno di cento, mentre quelle per “basal ganglia” sono quasi 900mila e ce ne sono quasi 150mila per “basilar artery”. Nel corso del proprio addestramento Med-Gemini avrebbe dovuto analizzare molti più testi contenenti le due versioni corrette rispetto alle poche con l’errore, non è quindi chiaro come mai in quel caso specifico abbia prodotto un termine che non ha senso da un punto di vista medico.

Nessuno ha rischiato la vita a causa dell’errore, ma i comportamenti anomali delle AI non devono essere sottovalutati, soprattutto in campo medico. In una serie di test, alcuni medici hanno notato che altri modelli, come MedGemma sempre sviluppato da Google, cambiano in modo significativo le loro risposte a seconda di come vengono interrogati, producendo quindi referti diversi per le stesse immagini analizzate. Se nel prompt, cioè nel testo che contiene la richiesta, venivano inseriti molti dettagli sul paziente, l’AI forniva una diagnosi corretta del problema, mentre nel caso di una richiesta più vaga il sistema non rilevava alcun problema di salute nonostante questo fosse evidente nella lastra.

Le grandi aziende tecnologiche che controllano i modelli più famosi, come ChatGPT e Gemini, dicono che le loro AI devono essere considerate come un aiuto per i medici e non come loro sostituti, implicando che il controllo finale spetti sempre al medico sia per quanto riguarda le diagnosi sia per i trattamenti da prescrivere. Ma anche in questo caso possono esserci dei problemi. Le AI saranno sempre più usate per scrivere i referti e le prescrizioni, in modo che siano più comprensibili per i pazienti e più veloci da compilare per i medici. Spetterà sempre a questi rileggerli per assicurarsi che l’AI non abbia frainteso o inventato una parte, col rischio che alla centesima prescrizione simile ad altre il medico si perda qualcosa con rischi per il paziente che potrebbero essere minimi come molto gravi.

Chi sviluppa i modelli ricorda spesso che in pochi anni ci sono stati enormi progressi nella loro accuratezza, a fronte di una quantità più o meno stabile di errori umani in campo medico, che potrebbero proprio essere ridotti grazie alla diffusione delle AI. Le potenzialità non mancano e ci sono già diverse esperienze promettenti, ma ci sono anche proposte per evitare che ci sia una “corsa alle AI” come già avvenuto in altri settori, in modo da poter studiare e analizzare meglio i costi e le opportunità del loro impiego in ambito sanitario.

Come ha spiegato sempre a The Verge Jonathan Chen, professore associato alla Stanford School of Medicine: «È un momento davvero strano, in cui molte di queste cose vengono adottate troppo velocemente in ambito clinico. Non sono ancora mature. […] Quando abbiamo a che fare con la medicina, qualcosa di imperfetto può sembrare intollerabile».