Su TikTok c’è tutto un filone di video contro i napoletani fatti con l’AI

Sono realizzati con il software di Google e ispirati a quelli che negli Stati Uniti deridono le persone afroamericane

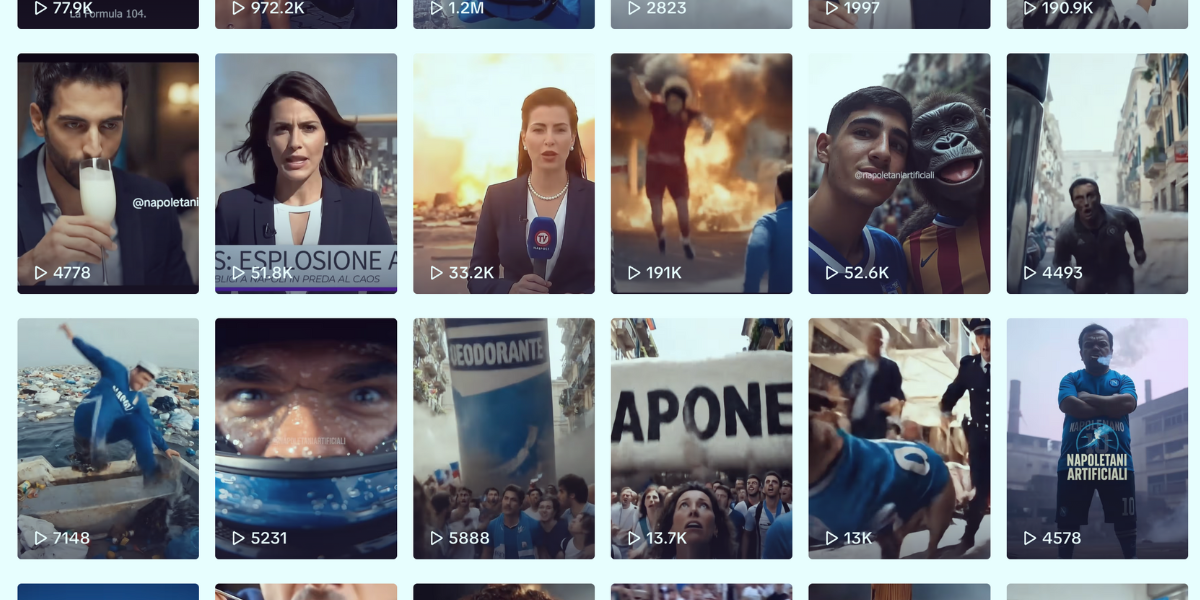

Su TikTok c’è un video con centinaia di migliaia di visualizzazioni in cui una giornalista annuncia che «anche quest’anno i soldi pubblici per la ristrutturazione delle strade sono stati usati per una statua in oro di Maradona». Dietro di lei, in mezzo alla strada, un anziano in bicicletta scompare dentro a un’imponente voragine. La giornalista scoppia allora in una grossa risata ed esclama: «Eccolo! Eh, vabbè, forza Napoli», e cammina via, come se non fosse successo nulla di grave.

Non è niente che sia successo davvero: è uno dei tanti video assurdi e stereotipati generati con l’intelligenza artificiale che in queste settimane stanno prendendo in giro e insultando le persone napoletane e la città di Napoli. Sono molto popolari sul TikTok italiano, sono generati con Veo 3, il nuovo modello presentato da Google a maggio, e appaiono inizialmente molto realistici, capaci di confondere anche gli utenti più allenati. I commenti a questi video sono solitamente pieni di insulti nei confronti del Sud Italia, tipo: «ho capito che era intelligenza artificiale quando ho visto che per strada non c’era la spazzatura».

A generare questi video sono soprattutto persone che hanno un tipo di senso dell’umorismo molto specifico, formato solitamente dopo aver passato molto tempo su forum come 4chan, Reddit o su siti ancora più di nicchia.

I video generati con Veo 3, in pochi secondi e con la sola intenzione di attirare l’attenzione e stranire o offendere gli spettatori con il minimo sforzo, possono essere fatti rientrare nella categoria più ampia dello shitposting (che, tradotto letteralmente, significa «pubblicare merda»), un tipo di post che è intenzionalmente di scarsa qualità, tendenzialmente assurdo, incomprensibile oppure controverso, e che viene fatto circolare in modo sia provocatorio che umoristico, con l’intento di essere capito da una ristretta nicchia di persone con un umorismo simile e di turbare tutti gli altri.

– Leggi anche: Una serie animata che non capirete

A ciò si aggiunge che su piattaforme come TikTok funzionano molto bene i video scioccanti che fanno arrabbiare: questi contenuti, quindi, continuano a circolare anche perché attirano una particolare attenzione anche tra gli utenti che non li trovano divertenti. Questo genere di video è già penetrato nella cultura condivisa dai giovani utenti italiani di TikTok, tanto che si trovano anche video girati da persone vere che replicano le situazioni assurde generate dall’intelligenza artificiale.

Negli Stati Uniti, lo stesso tipo di video – generato da Veo 3, pubblicato su TikTok, lungo di solito non più di 8 secondi, del tutto assurdo – sta prendendo di mira soprattutto gli afroamericani: il sito Media Matters ne ha trovati tantissimi, tra cui molti con milioni di visualizzazioni. Spesso sono video che rappresentano le persone afroamericane come scimmie, mostrate mentre ammettono di aver commesso dei crimini, corrono via dalla polizia, saccheggiano negozi o mangiano grandi quantità di pollo fritto e anguria (due cibi associati, negli stereotipi, alle persone afroamericane). Altri video identificati da Media Matters avevano invece come bersagli le persone ebree, cinesi o del sud-est asiatico.

– Leggi anche: Gli influencer vogliono farci arrabbiare

Nel caso dei video in italiano abbondano gli stereotipi che descrivono i napoletani come scippatori, fannulloni, truffatori che farebbero di tutto per non lavorare. Sul profilo “Napoletani artificiali”, che ha 43mila follower su Instagram e milioni di visualizzazioni su TikTok, c’è per esempio il video (ovviamente finto) di un uomo che si lancia da un elicottero annunciando: «Sono il primo napoletano a paracadutarsi nel Vesuvio – auguratemi buona fortuna!». I commenti sono pieni di persone che scrivono cose come «spero che non sia l’ultimo», «speravo che non fosse IA», «Napoletani, prendete tutti esempio dal vostro compaesano».

Simone Fontana, giornalista che da anni si occupa di sottoculture digitali in Italia, spiega che anche se questo genere di comicità più stereotipata è sempre meno presente nel mainstream, «su internet ci sono meno barriere all’accesso e anche meno rispetto della sensibilità altrui», e i contenuti come quelli di “Napoletani artificiali” hanno riempito una sorta di vuoto che in precedenza aveva avuto un certo successo su Facebook, dove esistevano decine di pagine anche molto seguite dedicate alla derisione delle condizioni di disagio, povertà e criminalità che si riscontrano in alcune zone del Sud Italia.

Negli ultimi anni queste pagine si erano in parte trasferite su Instagram e ora «tutta questa comicità si sta pian piano spostando su TikTok, che è la piattaforma perfetta nel momento in cui lo shitposting comincia a essere fatto di video creati con l’intelligenza artificiale». Spesso, poi, i video assurdi pubblicati su TikTok vengono scaricati dagli utenti e ri-pubblicati su X (l’ex Twitter), che negli ultimi due anni, per volontà del nuovo proprietario Elon Musk, ha ridotto fortemente la moderazione dei contenuti. Lì, spiega Fontana, «ci sono delle grosse comunità che non disdegnano affatto i discorsi antimeridionalisti», e che contribuiscono a far circolare ulteriormente questi video. Questi discorsi «sono ancora piuttosto accettati in Italia», secondo Fontana: «è la punta dell’iceberg di una questione molto più ampia e raramente problematizzata».

Le linee guida della piattaforma sostengono che su TikTok non siano ammessi «discorsi d’odio di alcun tipo, comportamenti basati sull’odio o che promuovono ideologie basate sull’odio verso gli altri. Questo include qualsiasi contenuto che attacchi un gruppo protetto in modo sia esplicito sia implicito». Allo stesso tempo Google, come molte altre aziende che mettono a disposizione modelli basati sull’intelligenza artificiale generativa, impedisce agli utenti di richiedere la generazione di video chiaramente offensivi nei confronti di determinate comunità marginalizzate. In questo caso, però, è evidente che entrambe le aziende stanno faticando ad applicare le proprie linee guida di fronte a una così grande massa di materiali.

– Leggi anche: Come sta cambiando il rione Sanità di Napoli

«Uno dei problemi è che i programmatori degli strumenti basati sull’intelligenza artificiale non riescono a immaginare tutti i modi in cui le persone possono essere crudeli le une con le altre», ha riassunto Meredith Broussard, professoressa dell’università di New York che si occupa delle discriminazioni perpetrate con l’aiuto dell’intelligenza artificiale, in un’intervista a Wired. «Quindi non riescono a mettere in atto un numero sufficiente di misure di sicurezza. È esattamente lo stesso problema che avevano avuto in precedenza i social network».