Crediamo di sapere come funziona un wc

O un orologio, o una serratura: solo quando dobbiamo spiegarlo ci rendiamo conto di quanto sia limitata la nostra comprensione delle cose

Se si chiede alle persone come funzionano oggetti di uso quotidiano come una cerniera lampo, una serratura a cilindro o lo sciacquone del wc, la maggior parte risponde di saperlo. Ma la spiegazione che forniscono mostra, non soltanto all’intervistatore o all’intervistatrice ma alle persone stesse, quante cose non sanno in realtà del funzionamento di quegli oggetti. Alcune ricerche condotte nel campo delle scienze cognitive mostrano da tempo non soltanto quanto sia diffusa e normale questa tendenza, ma quanto l’illusione della conoscenza influenzi la valutazione della propria comprensione di fenomeni di ogni genere: dal funzionamento di un wc alla politica estera al cambiamento climatico.

Tra la fine degli anni Novanta e l’inizio degli anni Duemila due scienziati cognitivi statunitensi della Yale University, Frank Keil e Leonid Rozenblit, cercarono di dimostrare scientificamente quanto le persone sanno rispetto a quanto pensano di sapere. E svilupparono un metodo che permise di osservare in diversi esperimenti un fenomeno da loro definito «illusione della profondità esplicativa» (Illusion of Explanatory Depth, IOED), per cui di fronte a un certo evento o fenomeno la nostra sicurezza di sapere cosa sta succedendo è molto spesso maggiore all’inizio che alla fine di quell’evento, e prima di interrogarci sul quel fenomeno anziché dopo.

Keil e Rozenblit chiesero a un gruppo di laureati in diverse discipline a Yale di valutare la propria conoscenza di determinati oggetti in una scala da 1 a 7, di fornire poi una spiegazione dettagliata del funzionamento di quegli oggetti e infine di valutare nuovamente la propria conoscenza. In uno degli esperimenti, per esempio, fu chiesto ai partecipanti di valutare quanto comprendessero il modo in cui funziona lo sciacquone di un wc: a ciascun punto della scala da 1 a 7 corrispondeva un certo livello di conoscenza. Da un certo punto in poi sapere come funziona uno sciacquone implicava sapere in che modo, premendo una leva sopra la tazza, questa si svuota e si riempie nuovamente di acqua fino a un certo livello.

Lo sciacquone, spiegato bene

L’invenzione del wc con lo scarico risale alla fine del Cinquecento ed è attribuita a un cortigiano della regina Elisabetta I d’Inghilterra, John Harington. Ma ci vollero diversi secoli, e vari miglioramenti favoriti dalla rivoluzione industriale nella produzione e nello smaltimento dei rifiuti, prima che diventasse un dispositivo comune. L’inventore scozzese Alexander Cumming ottenne il primo brevetto nel 1775, e l’imprenditore inglese Thomas Crapper produsse uno dei primi modelli di wc con sciacquone di grande successo alla fine dell’Ottocento.

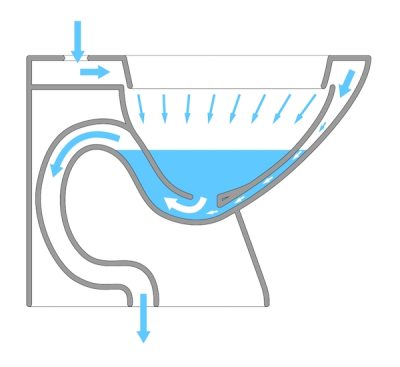

Per quanto semplice e familiare alle persone che abitano nella parte sviluppata e industrializzata del mondo, non sono molte quelle che sanno esattamente come funziona lo sciacquone nel modello di wc più diffuso, quello con tazza, serbatoio e sifone. Ciò che lo fa funzionare è il fatto che il sifone – di solito a forma di U o di S – curva più in alto rispetto al punto di uscita della tazza, per poi connettersi al tubo di scarico che raggiunge la fogna. Quando si tira lo sciacquone, l’acqua che scorre dal serbatoio nella tazza fa innalzare il livello dell’acqua che raggiunge un punto più alto rispetto alla curva del sifone.

(SouthHamsian/Wikimedia)

Questo passaggio svuota il sifone dell’aria e lo riempie d’acqua, innescando il cosiddetto “effetto sifone”, che aspira l’acqua dalla tazza e la manda giù attraverso lo scarico. Il meccanismo di fondo, in sostanza, non è diverso da quello che permette di sfruttare la forza di gravità e il principio dei vasi comunicanti per aspirare un liquido da un contenitore e riversarlo in un altro. L’effetto sifone cessa quando il livello dell’acqua nella tazza torna a essere più basso rispetto alla prima curva del sifone, e l’aria può quindi interrompere il processo. Nel frattempo viene pompata nel serbatoio altra acqua, pronta per l’utilizzo successivo.

Le conclusioni di Keil e Rozenblit

Alla richiesta di descrivere nel modo più dettagliato possibile tutte le fasi relative al funzionamento dello sciacquone la maggior parte dei partecipanti all’esperimento condotto da Keil e Rozenblit si rese conto di non avere molto da dire. Di fatto sapevano pochissimo di come funzioni uno sciacquone, e alla successiva nuova richiesta di valutare il loro livello di conoscenza abbassarono la stima iniziale di un punto o due. «Molti hanno mostrato uno stupore sincero e una certa umiltà per quanto poco sapessero rispetto a quanto originariamente pensavano», scrissero Keil e Rozenblit.

Gli stessi risultati – confermati anche utilizzando campioni di altre università, sia private che pubbliche – furono ottenuti in altri esperimenti in cui gli autori chiesero del funzionamento di altri strumenti e dispositivi di uso comune, tra cui l’orologio, il tachimetro e le serrature a cilindro, e anche i tasti del pianoforte, gli elicotteri e le macchine da cucire. Keil e Rozenblit li considerarono una dimostrazione dell’illusione della profondità esplicativa: i partecipanti, per loro stessa ammissione, credevano di sapere come funzionassero le cose meglio di quanto effettivamente sapessero. E bastava chiedere loro di fornire una spiegazione per renderli consapevoli di quella illusione.

In uno studio pubblicato nel 2006 sulla rivista scientifica Memory & Cognition la psicologa inglese dell’Università di Liverpool Rebecca Lawson ottenne risultati simili a quelli dello studio di Keil e Rozenblit, chiedendo a un gruppo di studenti di completare il disegno schematico di una bicicletta con le parti mancanti.

Lawson chiese ai partecipanti di disegnare grossolanamente ma nei punti corretti dello schema la catena, i pedali e la parte mancante del telaio della bicicletta. Circa la metà di loro non riuscì a completare il disegno correttamente, e nemmeno a scegliere il disegno corretto tra quattro diversi modelli proposti, mostrando un’incomprensione profonda dei fondamenti della progettazione di una bicicletta. Molti partecipanti, persino ciclisti esperti, commettevano errori frequenti ed evidenti, tra cui disegnare o scegliere il modello con la catena avvolta attorno sia alla ruota anteriore che posteriore (un modello che non potrebbe curvare).

Gli errori diminuivano se alle persone veniva prima mostrata una vera bicicletta. E in generale i risultati dimostrarono che la comprensione concettuale di un oggetto familiare e quotidiano da parte della maggior parte delle persone, scrisse Lawson, «è approssimativa e superficiale, anche per le informazioni che si incontrano frequentemente e sono facilmente comprensibili».

L’illusione della profondità esplicativa, un’espressione coniata da Keil e Rozenblit e riferita a un fenomeno analizzato da molti altri studiosi e studiose tra cui Lawson, spiega come ciascuna persona sopravvaluti la conoscenza delle cose che ha intorno. Per questa ragione l’espressione è stata in parte associata anche all’effetto Dunning-Kruger, la distorsione cognitiva per effetto della quale le persone poco esperte in una determinata materia tendono a sovrastimare la propria preparazione giudicandola superiore alla media.

Ma anziché riferirsi a una tendenza delle persone poco competenti in una certa materia a sovrastimare le proprie abilità, l’illusione della profondità esplicativa fa riferimento a un fenomeno sistemico e che in una certa misura interessa ogni persona: anche quelle con una preparazione specifica superiore alla media (come i ciclisti che sceglievano il modello di bicicletta sbagliato nello studio di Lawson). Inoltre, mentre l’effetto Dunning-Kruger descrive una «mancanza dell’abilità metacognitiva di rendersi conto della propria incompetenza», l’illusione della profondità esplicativa mostra quanto sia relativamente facile, nelle giuste condizioni, rompere quell’illusione.

L’evoluzione delle scoperte scientifiche

Oltre che spiegare un certo numero di fenomeni della contemporaneità, l’illusione della conoscenza è un efficace modello di spiegazione della bizzarra cronologia delle scoperte scientifiche nella storia dell’umanità, ha scritto lo psicologo comportamentale Adam Mastroianni, autore della newsletter Experimental History e in passato ricercatore della Columbia University.

Secondo Mastroianni guardando indietro nel tempo capita abbastanza spesso di chiedersi come sia possibile che civiltà e culture del passato, alcune delle quali responsabili di raffinate dimostrazioni nell’ambito della matematica (incomprensibili ancora oggi per la maggior parte delle persone), non avessero contezza delle reali cause di molti fenomeni scientifici. I Greci svilupparono i primi principi di trigonometria nel II secolo a.C., per esempio, grazie al lavoro di grandi astronomi come Ipparco di Nicea. Eppure, per secoli le persone pensarono – alcune lo pensano ancora – che la carne in decomposizione si trasformi in vermi.

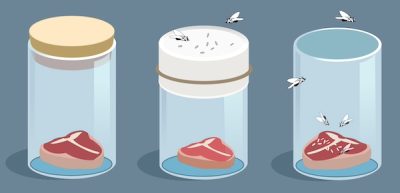

Fu il medico e naturalista aretino del Seicento Francesco Redi a contraddire l’idea della generazione spontanea, all’epoca conosciuta anche come abiogenesi aristotelica: la credenza largamente condivisa secondo cui forme di vita semplici come vermi e insetti possono nascere da elementi naturali inanimati come il fango o le carcasse in putrefazione. Nel libro del 1668 Esperienze intorno alla generazione degl’insetti Redi mostrò i risultati di una serie di esperimenti in cui da pezzi di carne crudi non si generavano parassiti, se venivano posti in barattoli sigillati e inaccessibili per i parassiti che in condizioni normali depositano le proprie uova sulla carne.

(Amitchell125/Wikimedia)

«Perché ci abbiamo messo così tanto tempo?», si è chiesto Mastroianni. Esempi come la falsificazione della generazione spontanea mostrano come in alcuni casi, abbastanza frequenti, una certa spiegazione dei fenomeni possa durare per secoli anche in presenza di strumenti che permetterebbero di arrivare a una scoperta scientifica tale da stravolgere quella spiegazione (mentre non è invece possibile, per esempio, osservare gli anelli di Saturno senza un telescopio).

Secondo Mastroianni casi come questo e tanti altri si spiegano assumendo il modello dell’illusione della profondità esplicativa come una sorta di proto-paradigma presente in ogni epoca, e intendendo l’illusione come una caratteristica umana, non un difetto. A fronte di fenomeni che apparirebbero altrimenti misteriosi e incomprensibili, assumiamo come fondata qualsiasi spiegazione sufficientemente condivisa che basti a rendere quei fenomeni sensati, anche se non lo sono.

È possibile che prima della scoperta della gravità le persone avessero l’illusione di conoscere perfettamente le ragioni per cui cadendo in un dirupo sarebbero precipitate e probabilmente morte. «Forse pensavano di capirlo meglio di quanto in realtà lo capissero, ma per i loro scopi lo capivano perfettamente», ha scritto Mastroianni. E in un certo senso ancora oggi, nonostante tutti i progressi, le persone comprendono mediamente la questione della forza di gravità solo un po’ meglio di quanto lo capissero i primi esseri umani.

«Se mi chiedessi perché le cose cadono, direi, compiaciuto, “Per la forza di gravità!”. Ma questa non è una spiegazione. Potrei andare un po’ più a fondo: “Bene, ogni cosa dotata di massa esercita una forza invisibile su altre cose, una forza che avvicina quelle cose. Più massa, più forza”. Ma perché le cose hanno questa forza invisibile? Come la esercitano? Perché questa forza avvicina le cose? Mi rendo conto che qualcuno saprebbe probabilmente rispondere a queste domande, ma io non posso. Per me sono soltanto una serie di regole arbitrarie nel grande gioco da tavolo della vita, proprio come lo erano per tutti i miei antenati.

L’illusione della profondità esplicativa, secondo Mastroianni, potrebbe anche spiegare perché la scoperta dei fenomeni scientifici non segue un ordine dalla cosa più intuitiva a quella meno intuitiva. È vero semmai il contrario: «scopriamo prima le cose meno evidenti, perché sono cose che ci rendiamo conto di non capire». In altre parole, laddove l’illusione di saper spiegare le cose è più forte e presente, il bisogno di una spiegazione più approfondita o alternativa è più debole.

Rispetto ad alcune dimostrazioni matematiche risalenti a un’epoca che va dal X al II secolo a.C., per esempio, l’esperimento di Galileo sulla caduta di due sfere di massa diversa dalla torre di Pisa, condotto per dimostrare che gli oggetti cadono con la stessa accelerazione, «sembra l’esperimento più ovvio del mondo», ha scritto Mastroianni. Eppure sono trascorsi molti secoli prima di arrivarci.

Un’ipotesi di spiegazione è che avevamo un’illusione di profondità esplicativa per il peso e la caduta degli oggetti, ma non per gli enti matematici. Che le cose più pesanti cadano più velocemente era abbastanza logico, dopo tutto, visto che sollevarle comporta uno sforzo maggiore. Come scrive il fisico italiano Carlo Rovelli la fisica aristotelica è sopravvissuta per secoli non perché fosse diventata un dogma, ma perché è un’ottima teoria, empiricamente ben fondata. Inoltre, ha scritto Mastroianni, la maggior parte delle persone difficilmente si trova in situazioni in cui deve sapere se una cosa cadrà più velocemente di un’altra: quindi, «perché preoccuparsi di buttare cose giù dalla Torre di Pisa?».

La natura collettiva della conoscenza

Riprendendo la nozione di illusione della profondità esplicativa sviluppata da Keil e Rozenblit, nel libro del 2017 L’illusione della conoscenza i due scienziati cognitivi statunitensi Steven Sloman e Philip Fernbach cercarono di spiegarla in funzione di un altro fattore: la natura intrinsecamente collettiva della conoscenza. Il fatto che gli esseri umani abbiano sviluppato società e tecnologie complesse nonostante la maggior parte delle persone non sappia com’è fatta una bicicletta né come funzioni un orologio non è un’anomalia, ma una condizione di base resa possibile dall’appartenenza degli esseri umani a una comunità della conoscenza.

Del resto è così che funziona la scienza, scrivono Sloman e Fernbach: la maggior parte delle conclusioni non è basata sull’osservazione diretta né sull’inferenza, bensì sull’autorità della comunità scientifica, racchiusa in testi e articoli che sono una fonte di prove «laddove la giustificazione diretta prenderebbe troppo tempo o sarebbe troppo costosa o difficile». La nostra comprensione dei fenomeni, sia in ambito scientifico che in altri, dipende da ciò che sanno le altre persone: quindi più del conoscere i fenomeni e le spiegazioni di per sé, è importante comprendere cosa è conosciuto e può essere giustificato dalle altre persone.

Poiché esistono limiti alla quantità di informazioni che un individuo è in grado di elaborare, la maggior parte della conoscenza non è nella testa di nessuna persona in particolare: scienziati e scienziate agiscono sulla fiducia, come chiunque tra noi. «Un laboratorio di biologia molecolare farà progressi solo se quelli che ci lavorano sono disposti a usare strumenti e metodi che non comprendono pienamente, ma che sono accettati dalla gran parte della comunità dei biologi molecolari», scrivono Sloman e Fernbach. Allo stesso modo guidiamo la macchina senza conoscere esattamente la tecnologia che permette di farla muovere, o accendiamo la luce in casa senza una piena comprensione del funzionamento degli interruttori.

Molto di quello che gli scienziati considerano vero è un problema di fede: non fede in un’entità superiore, ma nel fatto che gli altri stiano dicendo la verità. Ciò che distingue questa fede da quella religiosa è che esiste un potere superiore al quale appellarsi: ossia, il potere della verifica. Le affermazioni scientifiche possono essere controllate. Se gli scienziati non stanno dicendo la verità su un risultato, o se fanno un errore, è probabile che alla fine vengano scoperti, perché, se la questione è abbastanza importante, qualcuno proverà a replicare il loro risultato e fallirà.

In numerosi studi ed esperimenti degli ultimi due decenni sull’illusione della profondità esplicativa Sloman e Fernbach hanno riscontrato gli stessi risultati di Keil e Rozenblit, sia in campioni di persone comuni che tra laureati in università prestigiose degli Stati Uniti. E hanno osservato che le persone sovrastimano non soltanto la loro conoscenza del funzionamento di oggetti di uso comune, ma anche la loro comprensione di questioni politiche e argomenti scientifici come gli OGM e il cambiamento climatico.

Il problema dell’illusione della profondità esplicativa, secondo Sloman e Fernbach, è che spesso può portare le persone a sovrastimare le loro conoscenze e sottostimare quanto sia grande la parte di conoscenza della comunità. Di conseguenza spesso non ci rendiamo conto di quanto poco comprendiamo, e finiamo per essere troppo sicuri di noi stessi e certi di avere ragione su cose di cui in realtà sappiamo pochissimo. «La mente umana è, allo stesso tempo, geniale e patetica, brillante e stolta», scrivono Sloman e Fernbach. È capace delle imprese e delle conquiste più notevoli, e allo stesso tempo di impressionanti dimostrazioni di arroganza e dissennatezza.

È incredibile che gli esseri umani sappiano costruire bombe termonucleari, scrivono Sloman e Fernbach, quanto è incredibile che costruiscano poi effettivamente bombe termonucleari e le facciano esplodere anche senza essere del tutto consapevoli di come funzionino, come mostra la storia del test nucleare Castle Bravo, realizzato nell’atollo di Bikini, nelle Isole Marshall, il 1° marzo 1954. Gli scienziati che avevano lavorato alla bomba si aspettavano una forza esplosiva di circa 6 megatoni: circa trecento volte più potente della bomba sganciata nove anni prima su Hiroshima, che distrusse gran parte della città e uccise decine di migliaia di persone. Ma la bomba del test Castle Bravo esplose con una forza di 15 megatoni, circa mille volte più potente di quella della bomba su Hiroshima. Gli scienziati sapevano che l’esplosione sarebbe stata molto forte, ma sbagliarono la stima ben oltre la loro immaginazione.

– Leggi anche: Le Isole Marshall hanno un serio problema di rifiuti radioattivi

La storia è piena di eventi come Castle Bravo, scrivono Sloman e Fernbach: eventi che sembrano familiari e che suscitano un’impressione di comprensione più o meno completa, ma il cui reale contesto è diverso da come lo immaginiamo. Anche nella valutazione di fenomeni storici e sociali «i dettagli complessi si perdono nella notte dei tempi, mentre emergono racconti che semplificano e rendono digeribile la storia, in parte a vantaggio di un gruppo di interesse o di un altro».

Spesso, proseguono Sloman e Fernbach, a causa dell’illusione della profondità esplicativa né i politici né gli elettori si rendono conto di quanto poco comprendano. E ogni volta che un problema diventa abbastanza grande da essere argomento di dibattito, tendenzialmente è un argomento abbastanza vasto da non potere essere compreso del tutto. La competenza individuale è necessaria, ma il più delle volte non è sufficiente, perché soprattutto le questioni sociali hanno cause complesse ed effetti imprevedibili. I conflitti non sorgono mai soltanto per razzismo o per altri singoli fattori facilmente individuabili, secondo Sloman e Fernbach, ma sono il risultato di cause complesse e varie, che includono esperienze individuali, aspettative, incomprensioni e cattive pratiche: se tutte le persone comprendessero questa complessità e la accettassero, «la nostra società sarebbe probabilmente meno polarizzata».

Anziché prendere consapevolezza di questa complessità, le persone tendono invece «ad aderire a un dogma sociale o a un altro». E proprio perché la nostra conoscenza in gran parte dipende da quella degli altri, la comunità di cui facciamo parte finisce per modellare le nostre credenze, scoraggiando il rifiuto di opinioni che sono già condivise da altre persone intorno a noi. Avere maggiore consapevolezza di questa natura inevitabilmente condivisa e non individuale della conoscenza, scrivono Sloman e Fernbach, ci renderebbe più obiettivi riguardo alle nostre credenze e ai nostri valori, e ci porterebbe a comprendere più facilmente i nostri limiti sia individuali che come specie.

La tendenza a fare affidamento su conoscenze astratte, vaghe e acritiche, determinata dal fatto ovvio di non poter comprendere ogni cosa, è in parte una conseguenza del nostro normale modo di ragionare, basato sulla causalità. Prevedere un’azione richiede di comprendere come determinate cause producano determinati effetti, che «è esattamente ciò per cui la mente è stata progettata», scrivono Sloman e Fernbach. E da un certo punto di vista questo rende l’ignoranza umana ancora più sorprendente. Ma la ragione per cui le persone hanno una conoscenza così poco dettagliata di come funziona il mondo è che la mente è specializzata nella selezione delle informazioni che servono e nella contestuale rimozione di tutte le altre, molto più numerose.

Come specie non saremmo quindi così competenti, se dovessimo contare soltanto sulla limitata conoscenza individuale e sulla nostra dimestichezza con il ragionamento causale. Ciò che permette di superare i limiti delle nostre conoscenze è che «abbiamo accesso a quantità enormi di conoscenza che si trovano nelle teste delle altre persone», ciascuna delle quali possiede i propri piccoli domini di competenza. Ed è questa in definitiva la ragione per cui, fin dalle prime civiltà, le persone collaborano e hanno sviluppato competenze specifiche, ciascuna all’interno del proprio gruppo.

La possibilità di condividere le nostre competenze e conoscenze è uno dei grandi vantaggi del vivere in gruppi sociali. Non c’è da stupirsi se non riusciamo a distinguere ciò che è nelle nostre teste da ciò che è nelle teste degli altri, perché in genere – o forse sempre – compiamo azioni che li implicano entrambi. Ogni volta che uno di noi lava i piatti, ringraziamo il cielo che qualcuno sappia come si fa il detersivo e che qualcun altro sappia come far uscire acqua calda dal rubinetto. Noi non ne avremmo la minima idea.