I CAPTCHA non piacciono, ma servono

I test usati dai siti per distinguere umani e robot sono noiosi e stranianti, ma sostituirli non è facile e richiede anche una certa dose di riflessioni filosofiche

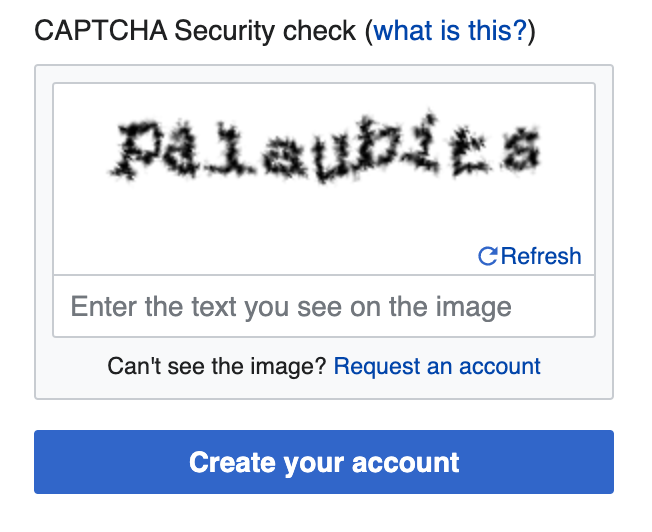

È praticamente impossibile, per chiunque usi internet con una certa regolarità, non aver mai incontrato un CAPTCHA, uno dei test di sicurezza usati per verificare – tramite il riconoscimento di numeri, lettere, suoni o semafori, o tramite un semplice click al posto giusto – che a voler fare una certa azione online sia un essere umano e non un bot, cioè un programma informatico creato per fingersi umano.

Ed è praticamente impossibile, pur essendo effettivamente umani, non aver fallito almeno qualche volta un CAPTCHA, con una conseguente e comprensibile frustrazione.

In effetti, tra molti utilizzatori di internet i CAPTCHA non godono di buona fama: «c’è qualcosa di unicamente avvilente» ha scritto Josh Dzieza su The Verge «nel vedersi chiedere di identificare un idrante e nel faticare a farlo». Nella sua newsletter, il giornalista Clive Thompson li ha definiti «poemi sinfonici sulla malinconia» che ogni volta ti fanno sentire «leggermente peggio di come stavi prima di vederli». Su Wired, Chris Stokel-Walker si è lamentato del fatto che «stanno diventando sempre più inutilizzabili, rendendo internet una landa desolata di piccoli rompicapi da decifrare».

Eppure, nel loro costante tentativo di diventare più difficili per i bot (e dunque anche per gli umani), i CAPTCHA, che furono inventati circa vent’anni fa, sono ancora qui. Ed è stato stimato che ogni giorno l’umanità spenda complessivamente qualcosa come 500 anni di tempo nel tentativo di risolverne a milioni.

(Wikimedia Commons)

Perché, pur tenendo conto del fatto che sono tutt’altro che infallibili, ancora non sono state trovate alternative valide ed efficaci. E se qualcuno dice che nel prossimo futuro sono destinati a scomparire, c’è anche chi pensa che, al contrario, non se ne andranno mai.

CAPTCHA è uno di quegli acronimi costruiti in modo tale da avere un suono familiare: in inglese, infatti, “captcha” suona simile all’espressione colloquiale “gotcha” (“ti ho preso”, ma anche “ti ho capito”). Ma CAPTCHA è anche l’acronimo imperfetto di Completely Automated Public Turing (test to tell) Computers (and) Humans Apart: il test di Turing completamente pubblico e automatico per distinguere i computer dagli umani.

Il test di Turing è quel test, suggerito nel 1950 dal matematico e crittografo britannico Alan Turing, che si propone di misurare la capacità di una macchina di rispondere a certe domande come farebbe un essere umano, in modo tale da permettere a una persona di capire se sta avendo a che fare con una macchina. In relazione ai CAPTCHA qualcuno parla di test di Turing inverso: perché si tratta di una macchina (il programma alla base del CAPTCHA) che prova a individuare umani. Il nome “Reverse Turing Test”, peraltro, fu preso in considerazione prima di optare per l’acronimo CAPTCHA.

Una prima forma di CAPTCHA, un’invenzione rivendicata da almeno due diversi gruppi di persone, arrivò verso la fine degli anni Novanta per provare a mettere freno al proliferare dei bot su AltaVista, un motore di ricerca pre-Google fondato nel 1995.

Come ha raccontato Nico Rivero, che si occupa di tecnologia per Quartz, a fine anni Novanta i bot «erano ovunque, lasciavano commenti spam, registravano milioni e milioni di indirizzi mail Yahoo e stavano intasando internet rendendone piuttosto spiacevole l’utilizzo». Ad AltaVista pensarono quindi di elaborare dei test in cui agli utenti veniva chiesto di identificare e riscrivere certe parole. Le parole erano volutamente mostrate in una bassa qualità, così da complicarne la lettura per i bot.

L’acronimo CAPTCHA fu introdotto però solo nel 2003, grazie a un gruppo di ricercatori della Carnegie Mellon University di Pittsburgh, in Pennsylvania. In un successivo articolo pubblicato per una rivista accademica di informatica i ricercatori scrissero:

«È possibile che già le abbiate viste: immagini colorate con testi distorti che stanno in fondo a qualche scheda di registrazione di qualche pagina web. Sono i CAPTCHA e li usano, tra gli altri, Yahoo, Hotmail e PayPal per prevenire registrazioni automatiche. Funzionano perché allo stato attuale nessun computer sa leggere un testo distorto tanto bene quanto un umano.

Quel che forse non sapete è che i CAPTCHA sono dei test che possono essere generati automaticamente e che i computer non superano. Notate il paradosso: un CAPTCHA è un programma che può creare e valutare test che quello stesso programma non passerebbe (cosa che succede anche con certi professori)».

I ricercatori capirono e spiegarono inoltre che, oltre a separare umani e bot, i CAPTCHA potevano essere usati per allenare – e se necessario sfruttare – le capacità dei bot o le potenzialità di determinate intelligenze artificiali. In altre parole: a furia di provare a leggere parole di difficile lettura, i computer avrebbero finito per imparare a decifrarle.

Nel 2006 i ricercatori trasformarono poi le loro teorie in reCAPTCHA, una società con cui si misero a vendere sistemi CAPTCHA ai siti che ne facevano richiesta. Tra i primi con cui collaborarono ci fu quello del New York Times, che sfruttò i CAPTCHA per completare la digitalizzazione del suo archivio cartaceo: nello specifico, certe parole dei CAPTCHA erano parole di vecchi articoli del New York Times difficili da leggere. reCAPTCHA beneficiava così del lavoro gratuito degli utenti chiamati a riconoscere parole che i computer non erano riusciti a interpretare. Quell’approccio fu poi usato anche per digitalizzare gli archivi di molte biblioteche. «I testi antichi hanno un futuro» scrisse Repubblica nel 2007: «li salverà un metodo antispam».

Nel 2009 reCAPTCHA fu comprata da Google, che tra le altre cose – dopo che le intelligenze artificiali erano diventate sempre più abili nell’identificare lettere e numeri – usò nuovi CAPTCHA fatti di immagini (quelli in cui bisogna riconoscere semafori, bus o strisce pedonali) per perfezionare certi suoi sistemi, per esempio Google Maps.

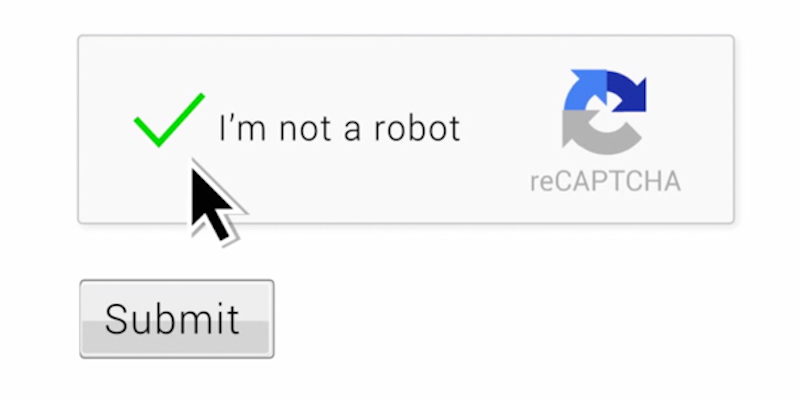

A quanto dice Google – che a sua volta usò reCAPTCHA per Google Books – è però una cosa che ormai non si fa più: non si sa se perché ormai inutile o per altri motivi. Sono peraltro diversi anni che Google permette di usare sistemi più semplici, come quello del singolo click su una determinata casella in cui dichiarare di non essere un robot. In questi CAPTCHA non è la domanda in sé che conta, ma è quello che Google riesce a ottenere e valutare mentre gira la rotellina.

Nel 2018 Google presentò poi reCAPTCHA v3, un nuovo sistema che chiedeva solo talvolta, diciamo in caso di dubbi, di riconoscere determinate immagini. Il sistema e le sue successive evoluzioni sono in grado – in breve – di interpretare azioni e interazioni col sito per valutare se sta avendo a che fare con un umano o un robot che si finge tale.

Passano gli anni e cambiano i sistemi – molti dei quali offerti da società diverse da Google – ma i CAPTCHA continuano spesso a essere oggetto di critiche, fastidi, meme e prese in giro, specie nei casi in cui anche anche ai CAPTCHA capita di sbagliare.

Nel considerarli «intollerabilmente deprimenti», Thompson ha scritto per esempio che quelli fatti di immagini da riconoscere «ci costringono a vedere il mondo con gli occhi di un’intelligenza artificiale» e che a renderle stranianti sono, tra le altre cose, le strane angolazioni e la quasi assenza di esseri umani o elementi naturali in quelle foto che «non sono state fatte da umani e non sono fatte per umani». Foto che alle volte sembrano «scene del crimine» e altre ancora «paesaggi post-apocalittici». L’unica eccezione, ha scritto Thompson, sono le palme: «Perché i CAPTCHA continuano a chiedermi di riconoscere palme? Cosa c’è sotto?».

Almeno finora, però, non sono state trovate soluzioni migliori per separare umani e bot. Tra le tante cose, come raccontato da Dzieza su The Verge, sono stati tentati sistemi basati su facce ed espressioni (alcuni dei quali, prontamente scartati, avevano a che fare anche con genere o etnia) e altri ancora che chiedevano di interpretare pitture rupestri (cosa che pare risulti particolarmente complicata per i computer).

Sono stati anche proposti e sperimentati CAPTCHA in formato di mini-giochi o puzzle, ma non è detto che ogni umano possa o voglia, in determinate situazioni, risolverli, e risolverli meglio di un computer. Quando si pensa alle alternative ai CAPTCHA così come li conosciamo, i problemi principali sono soprattutto due: il primo è che devono andare bene per qualunque umano si trovi a usarli, di qualsiasi età e formazione culturale, e possibilmente anche a chi per esempio non vede o non sente; il secondo è che, nella sintesi di Dzieza, «non sono tanto i bot a essere troppo intelligenti, sono proprio gli umani a essere scarsi».

Sempre Dzieza ha scritto inoltre che ragionando di CAPTCHA – che col passare degli anni si sono dimostrati spesso superabili da almeno certi bot – si rischia persino di finire nel filosofico e nel doversi chiedere: «qual è una qualità umana universale, e dimostrabile a una macchina, che una macchina non può imitare?»

Già da qualche anno c’è chi dice che a breve i CAPTCHA così come li abbiamo conosciuti spariranno, sostituiti dal riconoscimento facciale o da altri sistemi in grado di capire quel che c’è da capire senza farci nessuna domanda o richiesta specifica. Anche perché, come disse già nel 2019 il professore di informatica Jason Polakis, «siamo a un punto in cui rendere le cose più difficili per un software finisce col renderle troppo difficili per la maggior parte degli umani. Servono alternative ma non sappiamo quali».

Sarà però difficile rimpiazzare un sistema che, seppur sgradito a molti, è parecchio diffuso. Eli-Shaoul Khedouri, amministratore delegato di Intuition Machines, la società che offre il sistema hCaptcha (nota per certe sue domande piuttosto bizzarre) ha detto a Wired: «finché ci sarà qualcosa che le persone sapranno fare velocemente e meglio delle macchine, ci sarà una qualche forma di verifica di umanità». Secondo lui, nemmeno serve che le persone diano risposte giuste, basta che diano risposte affini a quelle di altri esseri umani e diverse da quelle che darebbe una macchina.

Esiste infine la possibilità che si diffondano sistemi (per esempio uno brevettato nel 2017 da Amazon) che funzionano al contrario: sono infatti pensati per essere risolti dai computer ma irrisolvibili dagli umani. In altre parole, risolverli vorrebbe dire essere dei robot: «sono chiamati Turing Test per fallimento» ha scritto Rivero su Quartz «e l’unico modo possibile per passarli è dare la risposta sbagliata».